Claude Code Remote Control + Ollama: Controla tu Servidor GPU desde el Movil

Si tienes un servidor GPU en casa o en la nube corriendo Ollama, puedes combinarlo con la funcion Remote Control de Claude Code para gestionar sesiones de programacion desde el movil mientras la inferencia ocurre en tu propio hardware. Asi es como funciona y por que es una configuracion muy practica.

Que es Remote Control?

Remote Control es una funcion en preview de Claude Code (disponible en planes Max) que permite continuar una sesion local de terminal desde el movil, tablet o cualquier navegador.

Los puntos clave:

- Todo se ejecuta localmente en tu maquina – los archivos nunca salen de ella

- Los servidores MCP y todo tu entorno de desarrollo siguen disponibles

- Solo la conversacion fluye a traves de la API de Anthropic por HTTPS

- No se abren puertos entrantes en tu maquina

Lo inicias con claude remote-control desde la terminal, o /rc desde una sesion existente. Te da una URL de sesion y un codigo QR que puedes escanear con la app de Claude.

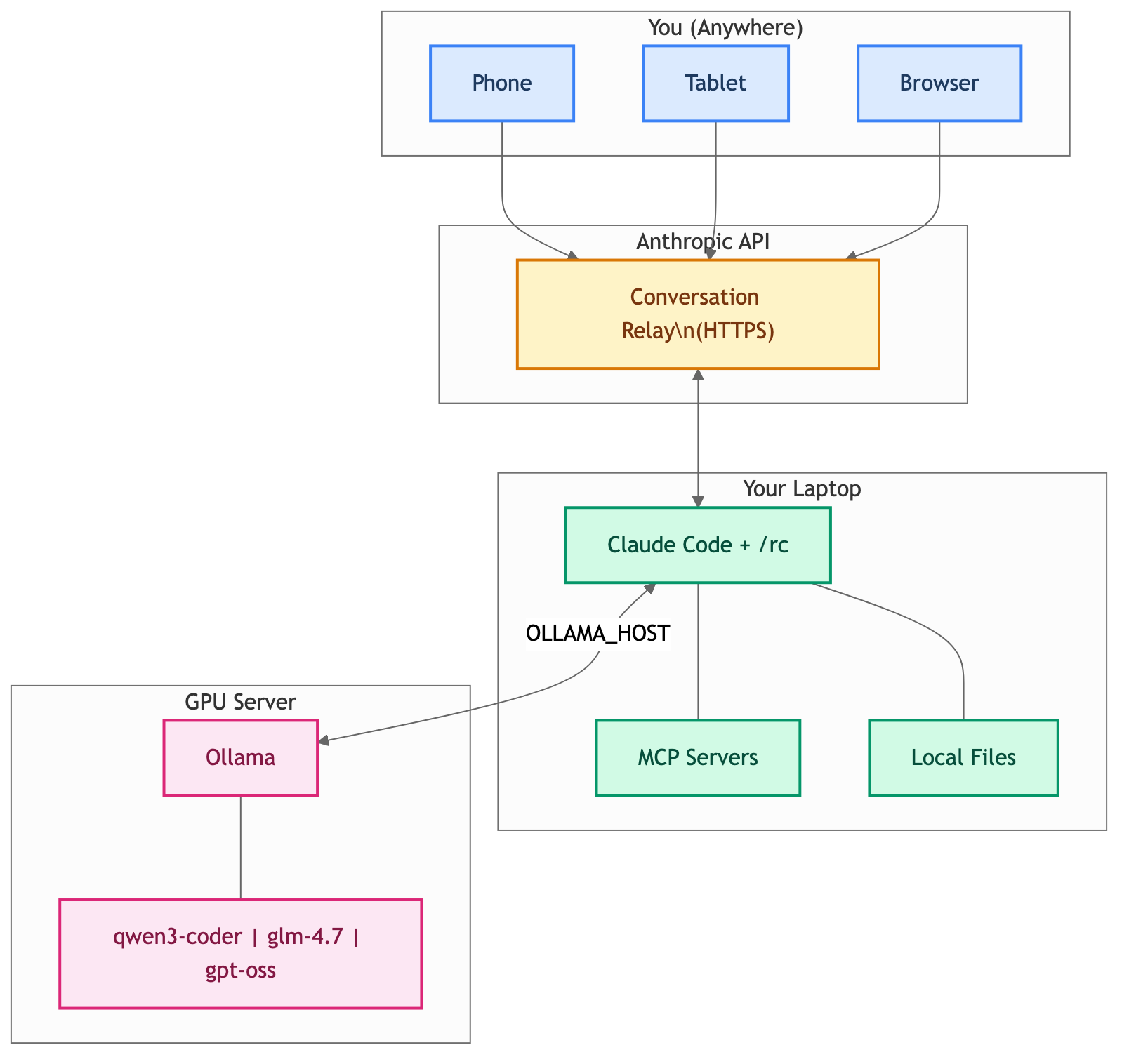

Como se Conecta Todo

El Caso de Uso: Ollama Remoto + Remote Control

Este es el escenario. Tienes un servidor GPU (quizas una estacion de trabajo con una tarjeta NVIDIA, o una instancia en la nube) corriendo Ollama. Quieres:

- Ejecutar Claude Code en tu portatil, apuntando a la instancia remota de Ollama

- Iniciar una sesion de Remote Control para monitorear e interactuar desde tu movil o tablet

- Alejarte del escritorio mientras la sesion sigue corriendo

Esto te da modelos self-hosted potentes haciendo la inferencia, con la comodidad de controlar la sesion desde cualquier lugar de tu casa (o mas alla).

Configuracion Rapida

Paso 1: Ollama en tu Servidor GPU

Asegurate de que Ollama esta corriendo y accesible en tu red. En el servidor GPU:

# Instalar Ollama si no lo tienes

curl -fsSL https://ollama.com/install.sh | sh

# Descargar un modelo con ventana de contexto grande

ollama pull qwen3-coder

# Iniciar Ollama escuchando en todas las interfaces

OLLAMA_HOST=0.0.0.0 ollama serve

Paso 2: Apuntar Claude Code al Ollama Remoto

En tu portatil, apunta a la instancia remota de Ollama y lanza Claude Code. Hay dos formas de hacerlo:

Opcion A: Usando ollama launch claude (recomendado)

La forma mas sencilla – Ollama se encarga de toda la configuracion:

export OLLAMA_HOST=http://<ip-servidor-gpu>:11434

ollama launch claude --model qwen3-coder

Opcion B: Variables de entorno manuales

Si prefieres control total sobre la configuracion:

export ANTHROPIC_AUTH_TOKEN=ollama

export ANTHROPIC_API_KEY=""

export ANTHROPIC_BASE_URL=http://<ip-servidor-gpu>:11434

claude --model qwen3-coder

Reemplaza <ip-servidor-gpu> con la IP o hostname real de tu servidor GPU. Los modelos que funcionan bien con esta configuracion incluyen qwen3-coder, glm-4.7, y otros con ventanas de contexto de 64K+ tokens.

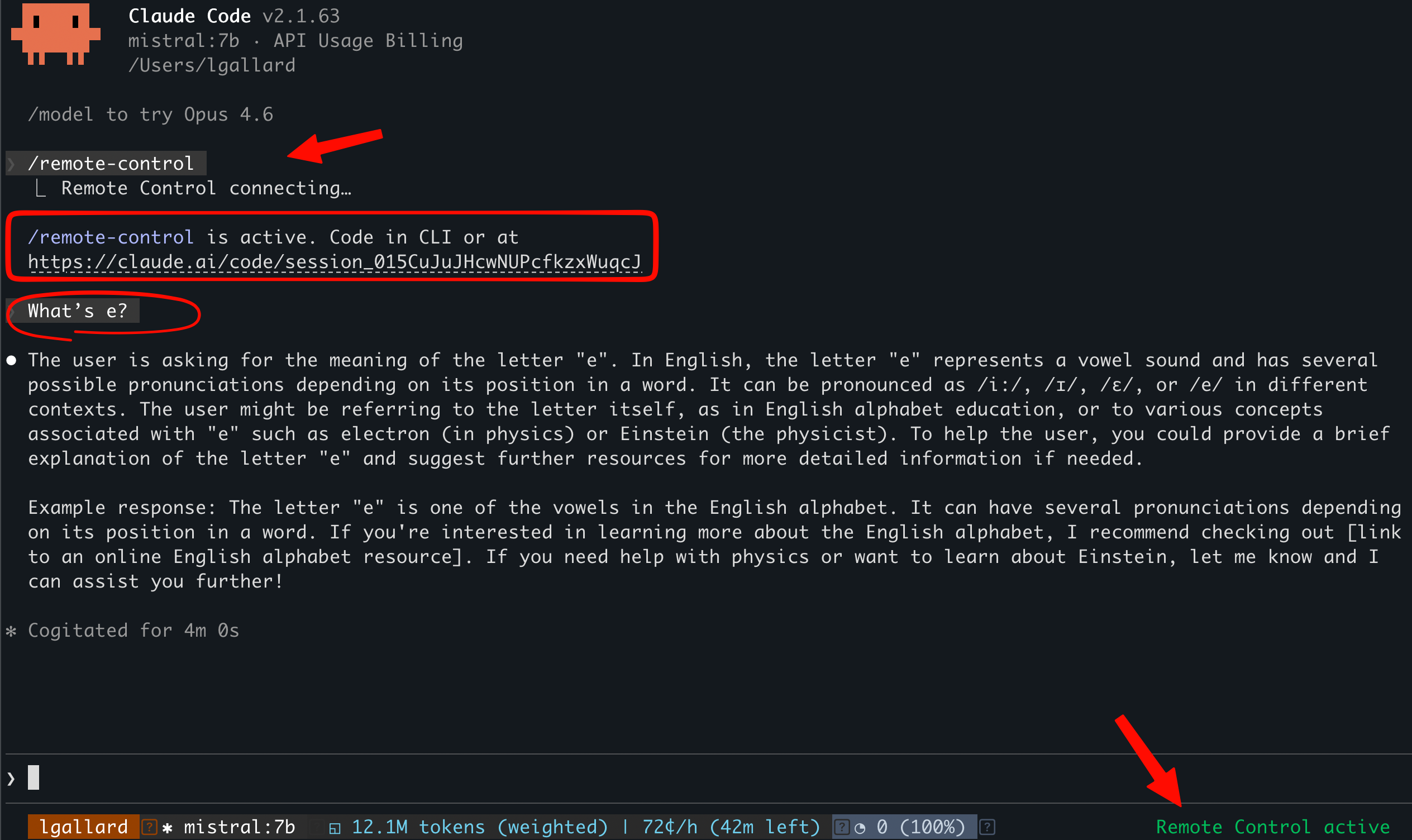

Paso 3: Iniciar Remote Control

Una vez que Claude Code esta corriendo y conectado a Ollama, inicia una sesion de Remote Control:

/rc

Veras una URL de sesion y un codigo QR. Escanea el codigo QR con la app de Claude en tu movil, o abre la URL en cualquier navegador. Ahora estas controlando tu sesion local de Claude Code – respaldada por la instancia de Ollama en tu servidor GPU – desde otro dispositivo.

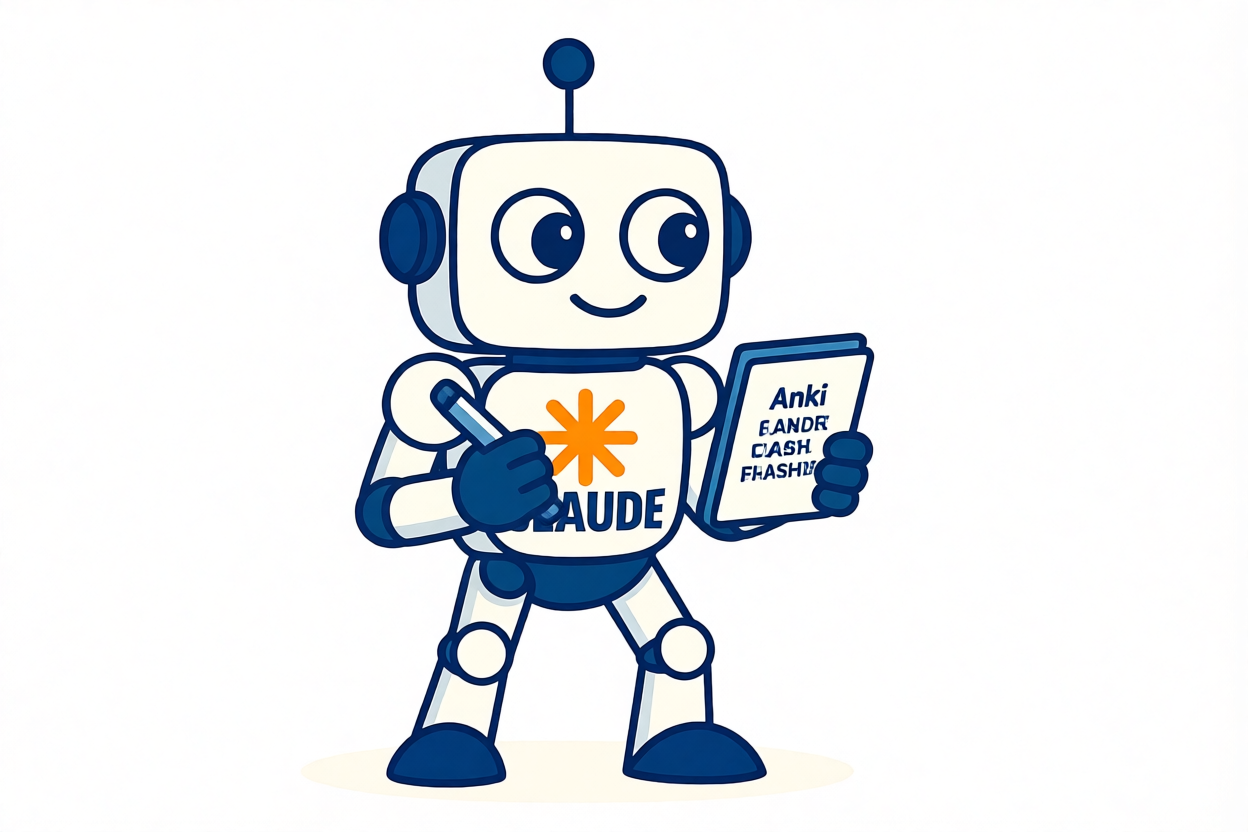

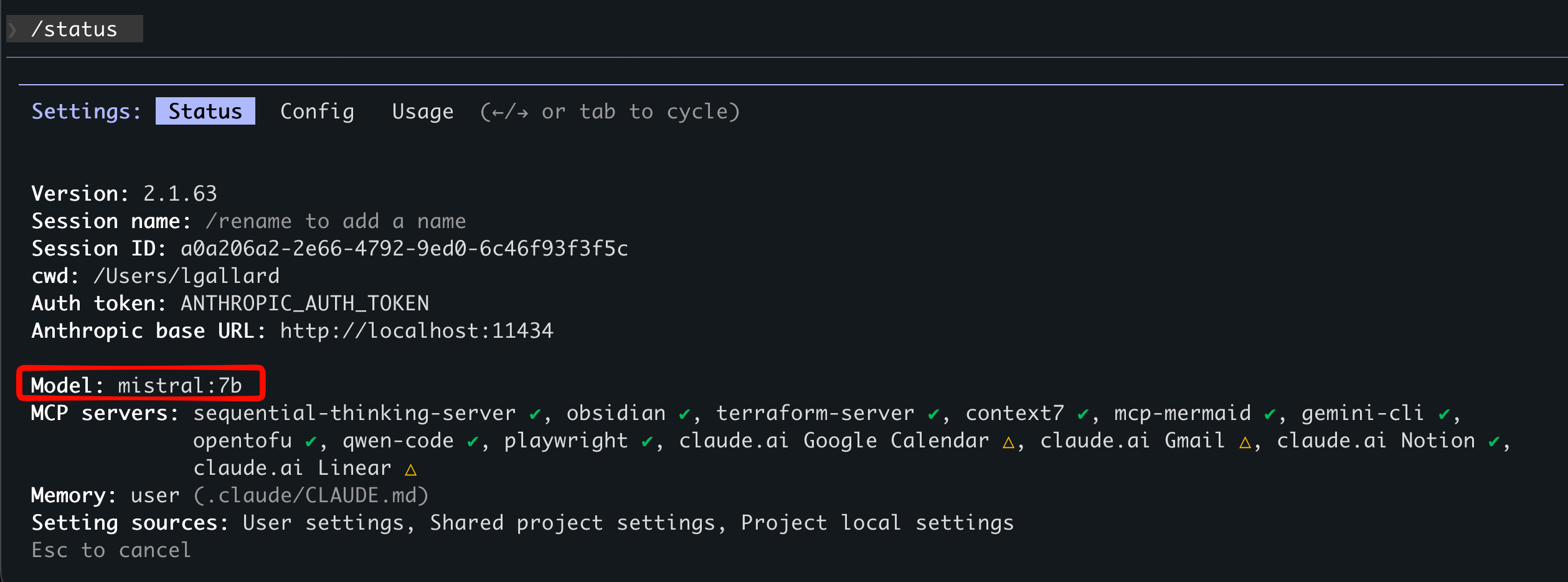

Asi se ve en la practica, usando mistral:7b como modelo. Observa la URL de sesion y el indicador “Remote Control active” en la barra de estado:

Puedes verificar la conexion ejecutando /status – muestra el modelo, la URL base de Anthropic apuntando a tu instancia de Ollama, y todos tus servidores MCP aun corriendo:

Y asi se ve la misma sesion en mi movil – la misma pregunta y respuesta, sincronizada en tiempo real a traves de la app de Claude:

Paso 4: Alejate del Escritorio

Tu terminal necesita quedarse abierta, pero no necesitas estar sentado frente a ella. Envia prompts desde tu movil, revisa resultados y sigue trabajando. La sesion sobrevive interrupciones breves de red y se reconecta automaticamente.

Cosas a Tener en Cuenta

-

La terminal debe quedarse abierta: Si la cierras, la sesion termina. Considera correrla dentro de

tmuxoscreen. En macOS, tambien puedes configurar hooks de Claude Code para ejecutarcaffeinateautomaticamente y evitar que tu Mac entre en suspension. Agrega esto a tu~/.claude/settings.json:{ "hooks": { "SessionStart": [{ "hooks": [{ "type": "command", "command": "caffeinate -dims &", "timeout": 5 }] }], "SessionEnd": [{ "hooks": [{ "type": "command", "command": "pkill -f 'caffeinate -dims'", "timeout": 5 }] }] } } - Una sesion remota a la vez: Cada instancia de Claude Code soporta una unica conexion remota.

- Timeout de red: Si tu maquina pierde conectividad por aproximadamente 10 minutos, la sesion expira.

- Seguridad de red de Ollama: Exponer Ollama en

0.0.0.0lo abre a toda tu red. Usa reglas de firewall o una VPN si estas fuera de una LAN de confianza. - Limitaciones de modelos: Los modelos open-source via Ollama pueden no soportar todas las funciones de tool/function calling de Claude Code. Funcionan bien para generacion de codigo, explicaciones y revision, pero operaciones complejas con multiples herramientas pueden no comportarse como se espera.

Conclusiones

Remote Control + Ollama es una forma directa de obtener lo mejor de ambos mundos: inferencia GPU potente y self-hosted con la flexibilidad de controlar tu sesion desde cualquier dispositivo. Sin costos de API, sin dependencia de la nube para la inferencia, y tu codigo se queda en tus maquinas.

Si ya tienes un servidor GPU corriendo Ollama, agregar Remote Control encima toma unos dos minutos. Pruebalo.