Más Allá de Anthropic: Usando Claude Code con Cualquier Modelo vía Claude Code Router y OpenRouter

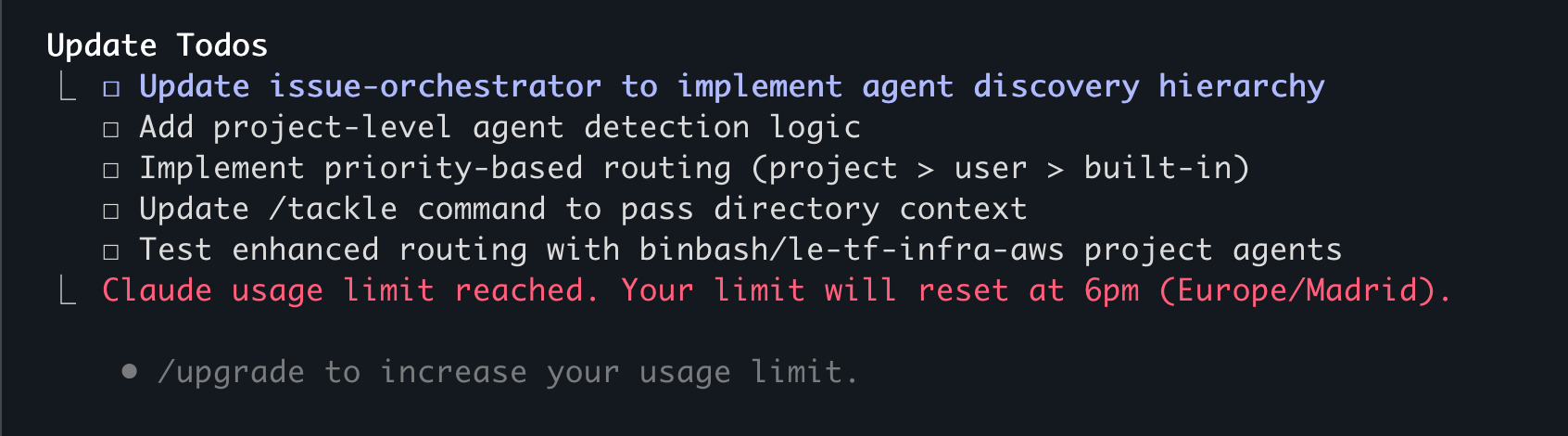

¿Alguna vez te has encontrado con el temido mensaje “Claude usage limit reached” a las 2 AM mientras depurabas un problema crítico? ¿O has deseado poder usar Claude Code con modelos GPT para tareas específicas? Después de experimentar estos problemas en carne propia, descubrí una configuración revolucionaria: Claude Code Router combinado con OpenRouter.

Esto no se trata solo de tener modelos de respaldo—se trata de enrutar inteligentemente las peticiones al modelo correcto en el momento adecuado, ya sea un modelo Qwen gratuito para tareas simples, una instancia local de Ollama para trabajo sensible, o GPT cuando necesitas capacidades específicas.

El Problema: La Limitación de Un Solo Proveedor de Claude Code

Aunque Claude Code es increíblemente poderoso, estar limitado a los modelos de Anthropic crea fricciones reales:

- Límites de uso que se reinician en momentos inconvenientes (6pm hora de Madrid para mí)

- Sin acceso a modelos especializados que podrían sobresalir en tareas específicas

- Acumulación de costos cuando podrías usar alternativas gratuitas para consultas más simples

- Preocupaciones de privacidad para código sensible que debería permanecer local

Claude Code Router resuelve estos problemas elegantemente interceptando peticiones y enrutándolas a cualquier proveedor de modelo compatible.

¿Qué es Claude Code Router?

Claude Code Router actúa como un proxy inteligente entre Claude Code y varios proveedores de LLM. Piénsalo como un operador de centralita inteligente que:

- Intercepta las peticiones API de Claude Code

- Enruta a diferentes modelos basándose en tus reglas

- Transforma peticiones/respuestas para compatibilidad API

- Gestiona múltiples proveedores de forma transparente

¿Lo bello de todo esto? Claude Code ni siquiera sabe que está sucediendo. Desde su perspectiva, sigue hablando con Claude—pero detrás de escena, podrías estar usando un modelo completamente diferente.

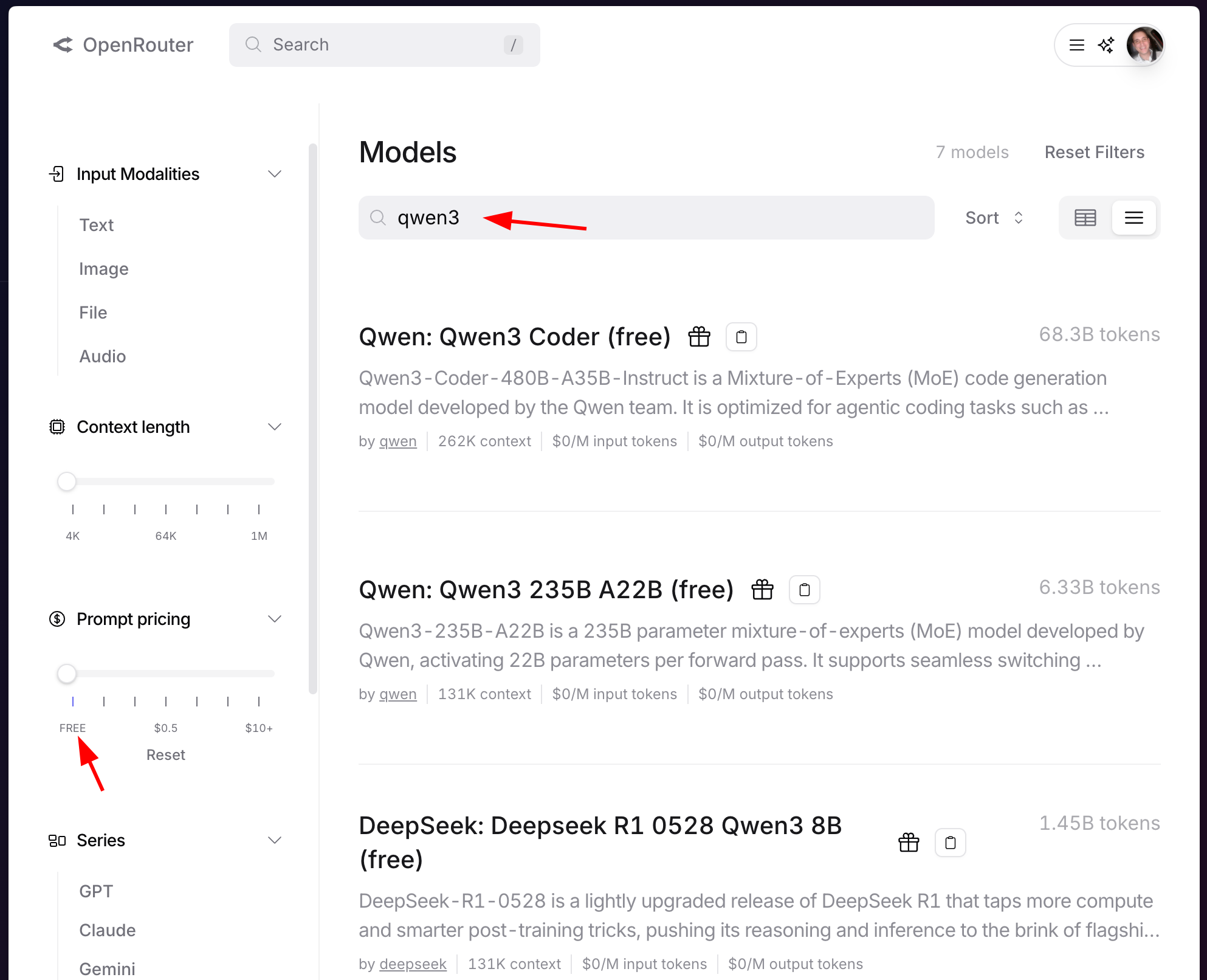

OpenRouter: La Puerta de Enlace Universal para LLM

OpenRouter lleva esta flexibilidad aún más lejos. Con acceso a más de 400 modelos de más de 60 proveedores a través de una única API, es como tener un control remoto universal para modelos de IA:

Modelos Gratuitos que Vale la Pena Explorar

Estos modelos no cuestan literalmente nada y manejan tareas rutinarias sorprendentemente bien:

- Qwen3 Coder: Optimizado para tareas de programación, ventana de contexto de 262K

- DeepSeek R1: Fuertes capacidades de razonamiento, especialmente para depuración

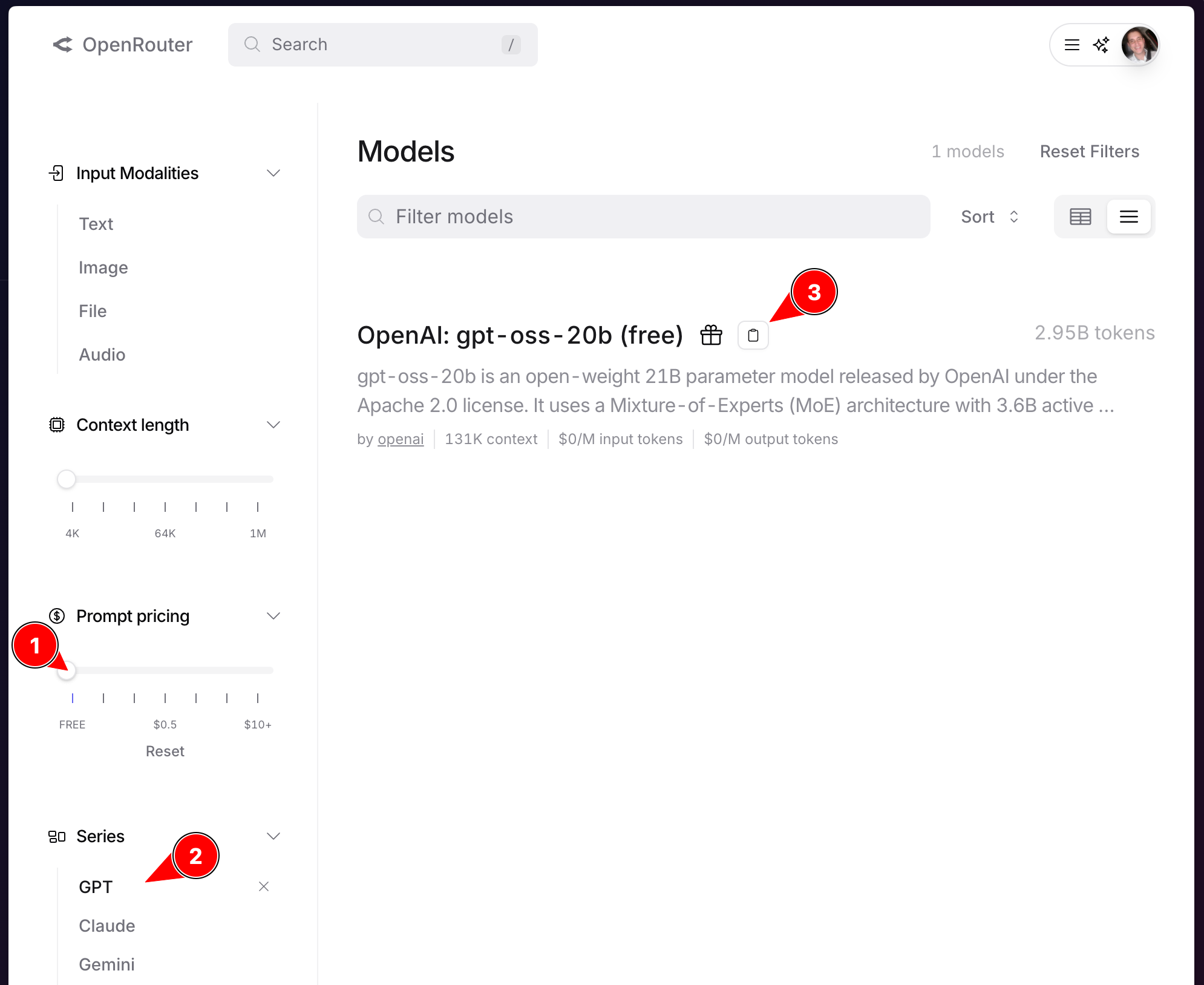

- OpenAI gpt-oss-20b: Modelo de peso abierto con sólido rendimiento general

Modelos Premium Cuando los Necesitas

A veces necesitas los pesos pesados. OpenRouter proporciona acceso a:

- Modelos GPT: Ten en cuenta que GPT-5 requiere BYOK (Bring Your Own Key), mientras que GPT-4o-mini está disponible con la API estándar de OpenRouter

- Serie Gemini de Google

- Modelos Claude de Anthropic (con potencialmente mejor disponibilidad)

Importante: Siempre verifica que tu modelo elegido soporte las funciones que necesitas—consulta la sección Consideraciones de Soporte de Herramientas por Modelo más abajo para detalles sobre limitaciones de herramientas/llamadas de función.

Autoalojado con Ollama

Para máxima privacidad y control, ejecuta modelos localmente:

- Privacidad completa: El código nunca sale de tu máquina

- Sin límites de uso: Ejecuta tanto como tu hardware permita

- Capacidad offline: Trabaja sin conectividad a internet

Configurando Todo

Paso 1: Instalar Claude Code Router

npm install -g @musistudio/claude-code-router

Paso 2: Obtén tu API Key de OpenRouter

- Dirígete a openrouter.ai

- Regístrate (autenticación con GitHub/Google disponible)

- Añade algunos créditos ($10 rinde mucho con modelos gratuitos)

- Genera tu API key

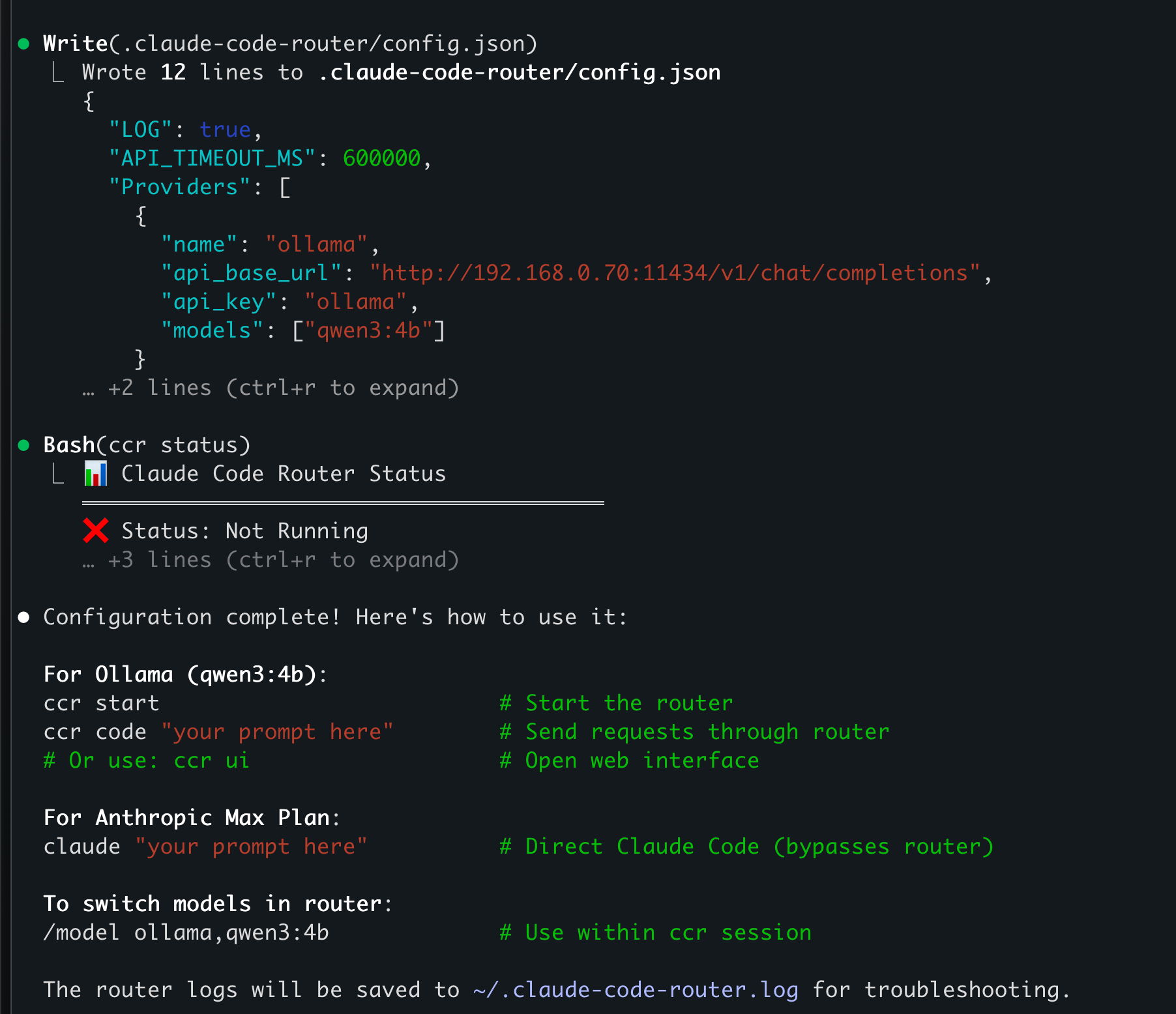

Paso 3: Configurar el Router

Crea .claude-code-router/config.json:

{

"LOG": true,

"API_TIMEOUT_MS": 600000,

"Providers": [

{

"name": "openrouter",

"api_base_url": "https://openrouter.ai/api/v1/chat/completions",

"api_key": "${OPENROUTER_API_KEY}",

"models": ["qwen/qwen3-coder:free", "openai/gpt-oss-20b:free"]

},

{

"name": "ollama",

"api_base_url": "http://localhost:11434/v1/chat/completions",

"api_key": "ollama",

"models": ["qwen3:4b", "deepseek-coder:6.7b"]

}

]

}

Nota la sintaxis ${OPENROUTER_API_KEY}—el router lee de variables de entorno por seguridad.

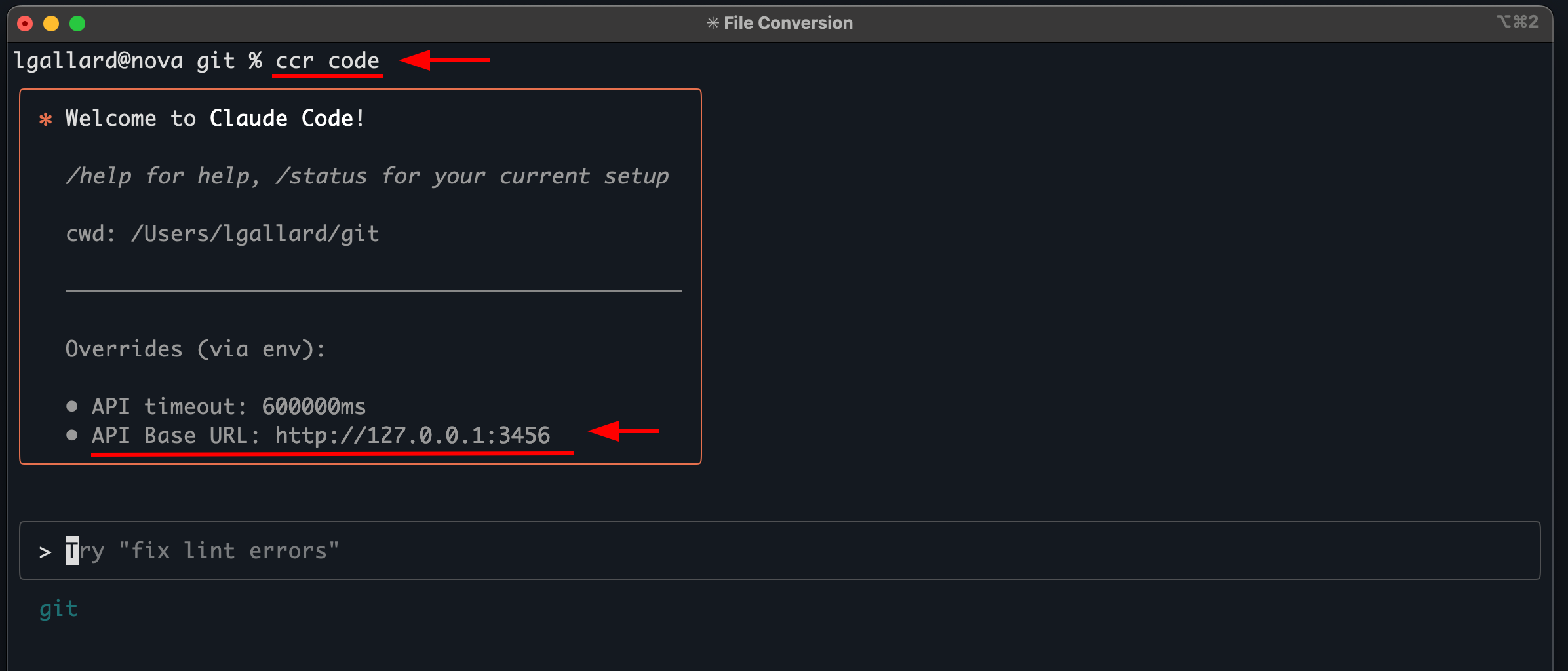

Paso 4: Lanzar y Usar

Inicia el router:

ccr start

Esto lanza el router en el puerto 3456 por defecto. Claude Code ahora enrutará a través de él automáticamente cuando esté configurado con el endpoint local.

Usa Claude Code como siempre:

ccr code "explica esta función"

Paso 5: Configurar Claude Code para Usar el Router

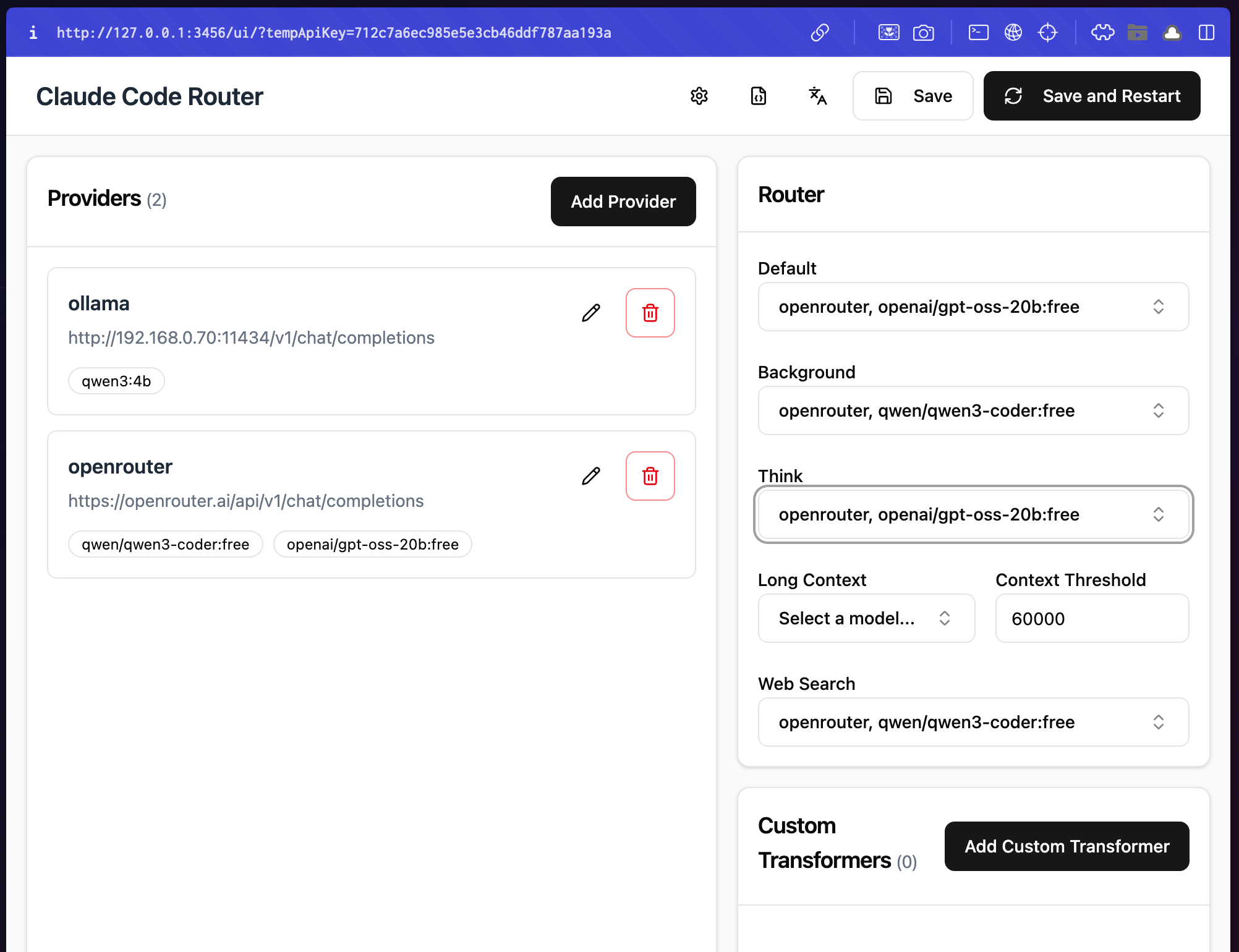

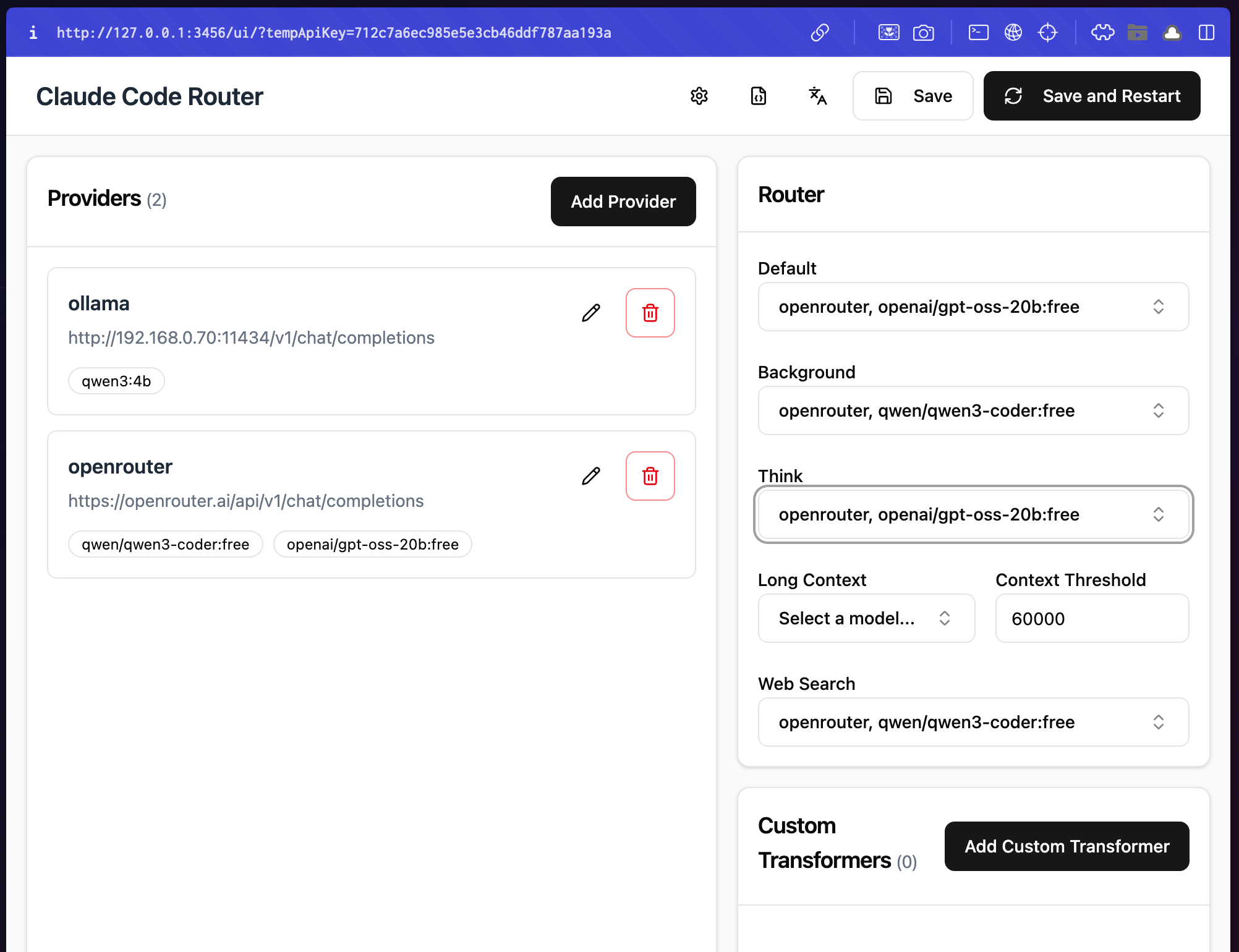

Para hacer que Claude Code enrute a través de tu router local, necesitas configurarlo para usar el endpoint del router. Abre la UI web para configuración visual:

ccr ui

Esto abre la interfaz web del router en http://localhost:3456 donde puedes:

- Configurar reglas de enrutamiento para diferentes escenarios (Default, Background, Think, Long Context)

- Asignar modelos específicos a cada categoría de enrutamiento

- Monitorear logs de peticiones para ver qué modelos están siendo utilizados

- Probar diferentes configuraciones antes de aplicarlas

La UI web proporciona una forma intuitiva de configurar enrutamiento inteligente sin editar archivos de configuración manualmente. Puedes asignar modelos rentables para tareas simples y modelos premium para operaciones complejas que requieren soporte de herramientas.

El Poder del Enrutamiento Inteligente

La verdadera magia ocurre cuando configuras reglas de enrutamiento. La UI te permite asignar diferentes modelos a diferentes escenarios:

- Default: Tu modelo principal para consultas generales

- Background: Modelo eficiente para procesamiento en segundo plano

- Think: Modelo optimizado para razonamiento en problemas complejos

- Long Context: Modelo con ventanas de contexto grandes para bases de código extensas

- Web Search: Modelo optimizado para tareas de investigación

Esto significa que una simple petición de “formatea este JSON” podría ir a un modelo Qwen gratuito, mientras que “arquitectura una solución de microservicios” activa GPT o Claude.

Consideraciones de Soporte de Herramientas por Modelo

Al configurar reglas de enrutamiento, es crucial entender que Claude Code depende fuertemente de herramientas/llamadas de función para muchas operaciones como edición de archivos, comandos git e interacciones del sistema. No todos los modelos soportan estas capacidades:

- Modelos con soporte de herramientas: Modelos Claude, serie GPT-4o, algunos modelos Gemini

- Modelos solo de texto: Muchos modelos gratuitos (Qwen, DeepSeek, etc.) que pueden manejar explicaciones y generación de código pero no ejecución de herramientas

- Mejor práctica: Enruta tareas que requieren herramientas a modelos confirmados con capacidad de herramientas, y usa modelos solo de texto para explicaciones, revisión de código y documentación

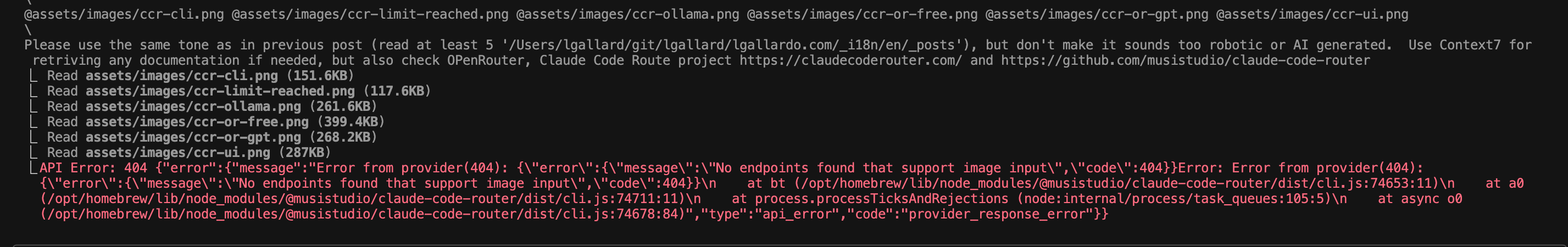

Como se muestra en los logs de error arriba, encontrarás errores de “No endpoints found that support” cuando intentes usar características avanzadas con modelos que no las soportan. Siempre verifica las capacidades del modelo antes de enrutar tareas críticas.

Flujo de Trabajo del Mundo Real

Así es como uso esta configuración diariamente:

- Preparación del standup matutino: Modelos Qwen gratuitos resumen los commits de ayer

- Desarrollo de características: Claude (a través de suscripción normal) para implementaciones complejas

- Correcciones rápidas: Ollama local para código privado de clientes

- Depuración fuera de horario: Créditos de OpenRouter cuando alcanzo límites de Claude

- Escritura de documentación: Modelos GPT que sobresalen en escritura técnica

El comando /model me permite cambiar sobre la marcha:

/model ollama,qwen3:4b # Cambiar a Ollama local

/model openrouter,gpt-4o # Usar GPT a través de OpenRouter

Consejos de Optimización de Costos

Después de un mes de uso, esto es lo que he aprendido:

- Empieza con modelos gratuitos: Te sorprenderá lo capaces que son para tareas rutinarias

- Usa umbrales de contexto: Enruta solo consultas complejas a modelos premium

- Monitorea los logs: Los logs del router ayudan a identificar qué consultas realmente necesitan modelos premium

- Aprovecha Ollama: Para tareas locales repetitivas, el autoalojamiento es imbatible (si tu hardware lo permite)

Solución de Problemas Comunes

El router registra en ~/.claude-code-router.log por defecto, lo que ayuda a diagnosticar problemas:

- Conexión rechazada: Verifica si el router está ejecutándose (

ccr status) - Modelo no encontrado: Verifica que el nombre del modelo coincida con el formato de OpenRouter

- Errores de timeout: Aumenta

API_TIMEOUT_MSpara modelos más lentos - Problemas con API key: Asegúrate de que las variables de entorno estén configuradas correctamente

Más Allá del Enrutamiento Básico

Claude Code Router soporta características avanzadas que aún estoy explorando:

- Transformadores personalizados: Modifica peticiones/respuestas programáticamente

- Scripts de enrutamiento JavaScript: Lógica compleja para selección de modelos

- Integración con GitHub Actions: CI/CD con enrutamiento de modelos

- Múltiples fallbacks de proveedores: Failover automático cuando los proveedores están caídos

La Conclusión

Esta configuración transformó mi experiencia con Claude Code de frustrante (alcanzar límites) a liberadora (flexibilidad infinita). Ya sea que busques reducir costos, evitar limitaciones, o simplemente experimentar con diferentes modelos, Claude Code Router + OpenRouter proporciona la solución perfecta.

Empieza simple—configura un modelo gratuito como respaldo para cuando alcances límites. Una vez que experimentes la flexibilidad, naturalmente expandirás tus reglas de enrutamiento para optimizar diferentes escenarios.

El futuro del desarrollo asistido por IA no se trata de elegir el “mejor” modelo—se trata de tener el modelo correcto para cada tarea específica. Esta configuración te lleva allí hoy.

¿Has probado enrutar Claude Code a través de modelos alternativos? ¿Cuál es tu experiencia con modelos gratuitos para tareas de desarrollo? Comparte tus configuraciones en los comentarios.